MCP标准与本地技能展开较量,决定LLM代理的最佳扩展方式

•3 阅读•4分钟•视野

LLMAgentMCPSkills

•3 阅读•4分钟•视野

MCP概述

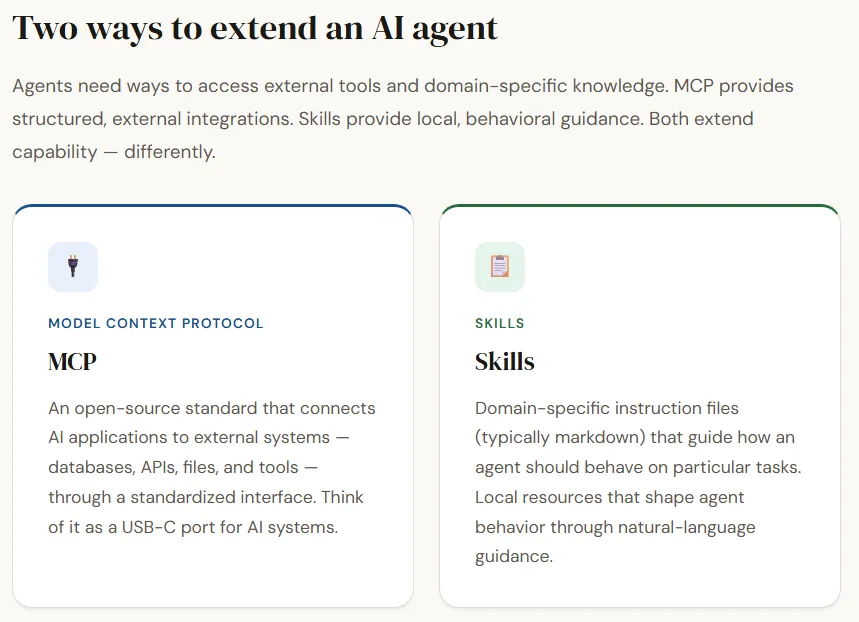

Model Context Protocol(MCP)是一套开源的标准化接口,旨在让LLM通过统一的调用方式访问数据库、文件系统、第三方API等外部资源。类似USB‑C的即插即用,MCP把工具抽象为 tool name + input schema + deterministic output,从而实现可预测的交互。

典型流程:

- 用户查询 → AI代理 → 调用MCP工具 → MCP服务器执行业务逻辑 → 返回结构化结果 → 代理基于结果生成最终回复

优势

- 结构化、可复现:相同输入必得相同输出,适合爬取网页、查询SQL等需要精确返回的场景。

- 统一治理:所有工具通过同一协议接入,便于权限、审计和版本管理。

局限

- 工具发现成本:工具数量激增时,代理需依据名称和描述挑选,易产生选择困难。

- 网络延时:每次调用都伴随远程请求,导致多步骤工作流出现累计延迟。

- 部署复杂度:需要配置服务器、认证机制和会话管理,对非专业团队门槛较高。

本地Skill概述

Skill是一种基于自然语言的行为指令集合,通常以 Markdown 文件形式存放在本地目录。代理在匹配到用户意图后,将对应Skill的完整指令注入上下文,随后依据这些指令完成任务。

典型流程:

- 用户查询 → AI代理 → 匹配Skill → 将Skill文档加载进上下文 → 按指令执行 → 返回结果

优势

- 部署简便:仅需文件系统即可使用,无需额外服务器或网络调用。

- 高度可定制:开发者可直接编辑 Markdown,快速迭代业务逻辑。

- 低延时:所有指令本地执行,几乎无网络开销。

局限

- 执行确定性不足:Skill依赖LLM自行解释指令,容易出现误解或幻觉,结果不够可预测。

- 上下文占用:复杂Skill会占用大量上下文空间,影响长对话的推理效率。

- 维护成本:大量Skill分散在文件系统中,缺乏统一的版本控制和审计机制。

两者优劣对比

| 维度 | MCP | 本地Skill |

|---|---|---|

| 实现方式 | 标准化API调用,返回结构化数据 | 自然语言指令,注入上下文 |

| 可预测性 | 高(确定性输出) | 中等至低(依赖LLM解释) |

| 部署门槛 | 中等‑高(需要服务器) | 低(仅文件) |

| 网络依赖 | 必须 | 无 |

| 适用场景 | 数据查询、外部系统交互、需要审计的企业业务 | 快速原型、内部工具、行为引导类任务 |

适用场景与选型建议

- 需要精准、可审计的数据获取(如金融报表、法律文档检索)推荐使用MCP,利用其确定性和统一治理能力。

- 对响应速度要求极高且业务逻辑相对固定(如本地代码风格检查、内部FAQ)可优先考虑Skill,省去网络往返。

- 混合需求:在同一系统中同时使用MCP与Skill,MCP负责外部数据拉取,Skill负责业务流程编排,可兼顾可靠性与灵活性。

结语

MCP与本地Skill并非相互排斥的技术,而是针对不同痛点提供的两条扩展路径。开发者在构建LLM代理时应先明确业务对确定性、延时和运维复杂度的要求,再在两者之间做出权衡。合理组合可以让代理既保持对外部资源的可靠访问,又保留快速迭代的灵活性,推动生成式AI在企业级场景的落地。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。