OpenAI推出全新Responses API代理运行时,构建安全可扩展的计算环境

•10 阅读•3分钟•前沿

OpenAIAgentResponses APIShell tool

•10 阅读•3分钟•前沿

背景

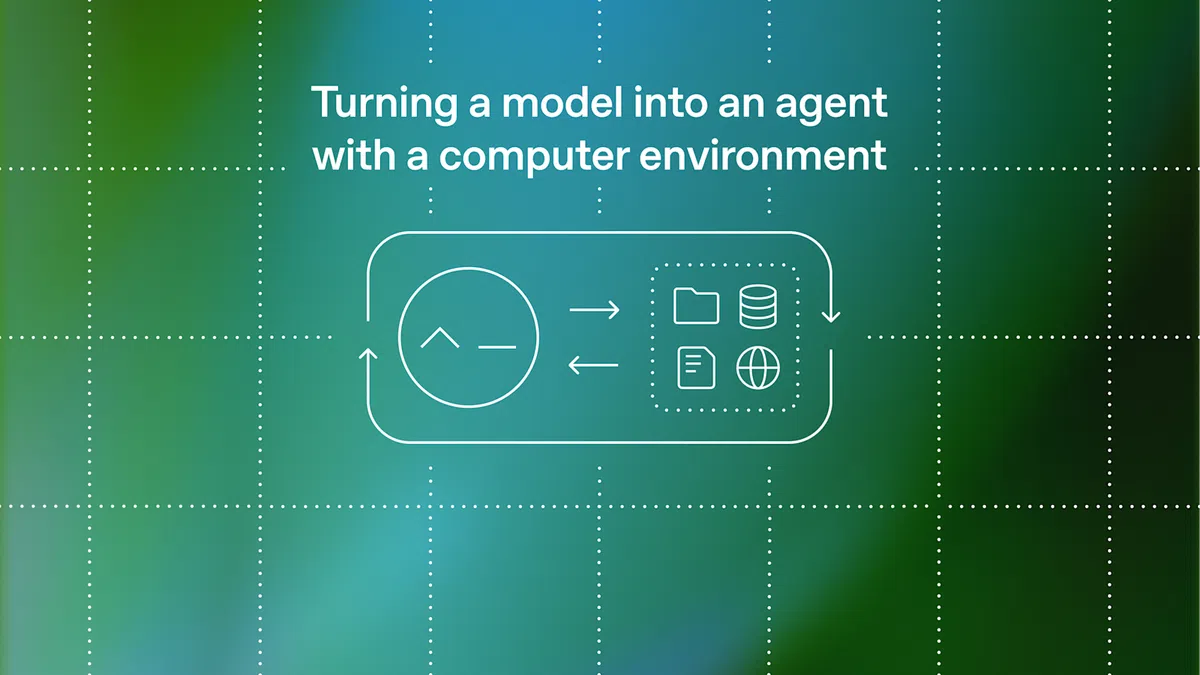

随着大模型从单一任务向复杂工作流转变,单纯的文本提示已难以满足实际需求。OpenAI 通过在 Responses API 中嵌入计算环境,使模型能够直接操作文件、调用 API、甚至运行自定义代码,从而实现更广泛的业务场景。

Shell 工具

Shell 工具是最基础的执行单元。模型在生成 shell 命令后,平台会在托管容器中调用对应的 Unix 工具(如 grep、curl、awk 等),并将输出实时回传给模型。相比仅支持 Python 的 Code Interpreter,Shell 能运行 Go、Java、NodeJS 等多语言程序,显著提升了代理的通用性。

代理循环编排

- 模型提出动作:在上下文中声明使用

shell工具,并给出具体命令。 - 平台执行:Responses API 将命令转发至容器运行时,启动独立会话。

- 实时流式返回:命令输出被流式包装为结构化工具响应,注入下一轮提示。

- 循环迭代:模型依据返回结果继续规划后续命令,直至给出最终答案。

平台支持并行执行多个容器会话,并对单个命令的输出大小进行上限控制(如 1,000 字符),保证上下文预算不被冗余日志耗尽。

上下文压缩机制

长时间运行的任务会迅速填满上下文窗口。为防止重要信息丢失,Responses API 引入原生压缩功能:模型在每轮对话结束时生成 压缩项,该项以加密且高效的 token 表示关键状态。服务器端可在设定阈值后自动触发压缩,将历史对话压缩为单一 token,同时保留高价值片段。此机制让 Codex 等模型在多步编程或数据处理任务中保持连贯性。

容器上下文与技能库

- 文件系统:开发者可预先上传文件或数据集,模型通过

ls、cat等命令有选择地读取,避免一次性将大文件塞入提示。 - 结构化存储:推荐使用 SQLite,模型仅需查询所需行列即可,大幅降低带宽和计算开销。

- 受控网络:所有出站请求经过侧车代理,统一的策略层实现白名单、访问控制和凭证注入,防止敏感信息泄露。

- 技能 (Skill) 包:可将常用工作流封装为

SKILL.md+ 脚本的文件夹,上传后在提示中自动加载。模型通过文件系统发现并执行这些技能,实现可复用的业务逻辑。

未来展望

OpenAI 表示,随着模型对工具使用的训练持续深化,后续将进一步扩展容器的硬件资源(GPU、TPU)并提升并发规模,使代理能够处理更高算力需求的任务,如大规模数据分析或实时视频处理。同时,原生压缩和技能库的迭代将帮助开发者在安全可控的前提下,快速构建端到端的 AI 代理系统。

“语言模型不应止步于文字输出,真正的价值在于它们能安全、可靠地执行真实世界的计算任务。” — OpenAI 工程团队

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。