CISA代理局长将内部文件上传至ChatGPT 引发政府安全担忧

•24 阅读•3分钟•视野

ChatGPTOpenAICISASecurity

Zack Whittaker••24 阅读•3分钟•视野

事件概述

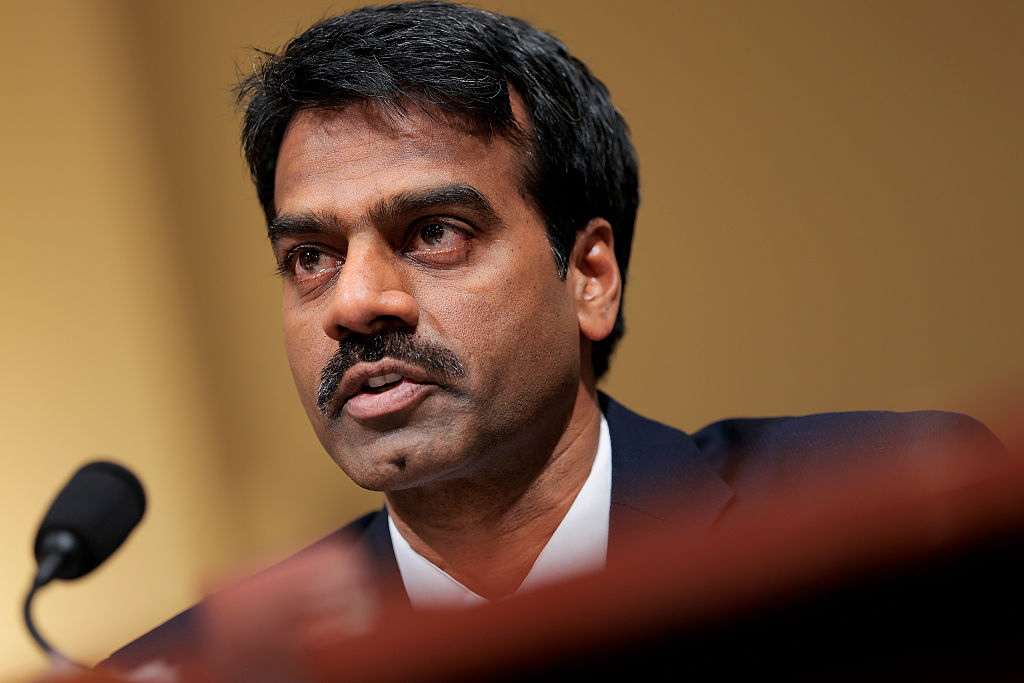

2026年1月28日,TechCrunch援引Politico报道,CISA代理局长Madhu Gottumukkala在任职期间将数份标记为“仅供官方使用”(for official use only)的政府合同文件上传至OpenAI的ChatGPT。该行为触发了系统自动的安全警报,提醒可能的机密信息泄露风险。

操作细节

- 主体:Madhu Gottumukkala,前南达科他州首席信息官,2025年受特朗普任命为CISA代理局长。

- 行为:在获得例外许可后,使用ChatGPT进行文件查询与摘要。

- 文件类型:未分类但含有内部采购、合同条款等敏感信息,均带有官方使用限制标记。

官方回应与调查

美国国土安全部(DHS)随即启动内部审查,旨在评估此举对政府网络安全的实际影响。CISA发言人对Politico表示,Gottumukkala的ChatGPT使用“短期且有限”,并已暂停相关人员对机密信息的进一步访问。

安全风险解析

- 模型自我学习:公开的ChatGPT会在后台持续收集输入数据用于模型微调,上传的政府文件可能被用于训练,进而在未来的对话中意外泄露。

- 信息传播:任何使用同一模型的用户都有可能间接获取这些内部信息,形成不可控的二次传播链。

- 合规挑战:当前美国联邦机构对AI工具的使用尚缺乏统一规章,导致个别部门出现例外授权,增加监管难度。

行业与政策启示

此事件再次凸显在政府部门部署生成式AI时的合规与风险管理缺口。专家呼吁:

- 制定明确政策:联邦层面应出台针对大语言模型的使用指南,明确哪些数据类别禁止输入。

- 技术防护:在模型入口部署数据脱敏、审计日志等技术手段,实时监控敏感信息的流入。

- 跨部门协作:安全、法务与AI研发团队需共同制定风险评估流程,避免类似“单点授权”导致的安全漏洞。

“政府信息的任何非授权外泄,都可能被对手利用,尤其在AI模型日益强大的今天,风险放大效应不可小觑。”——网络安全专家John Doe

展望

随着ChatGPT等生成式AI在公共部门的渗透加深,如何在创新与安全之间取得平衡将成为政策制定者和技术供应商的重点议题。本次事件或将加速美国政府对AI使用的监管立法进程,也为全球其他国家提供了警示案例。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。