Microsoft发布Phi-4-Reasoning-Vision-15B 打造紧凑型多模态推理模型

•0 阅读•3分钟•前沿

MicrosoftPhi-4SigLIP-2GUI

•0 阅读•3分钟•前沿

模型概览

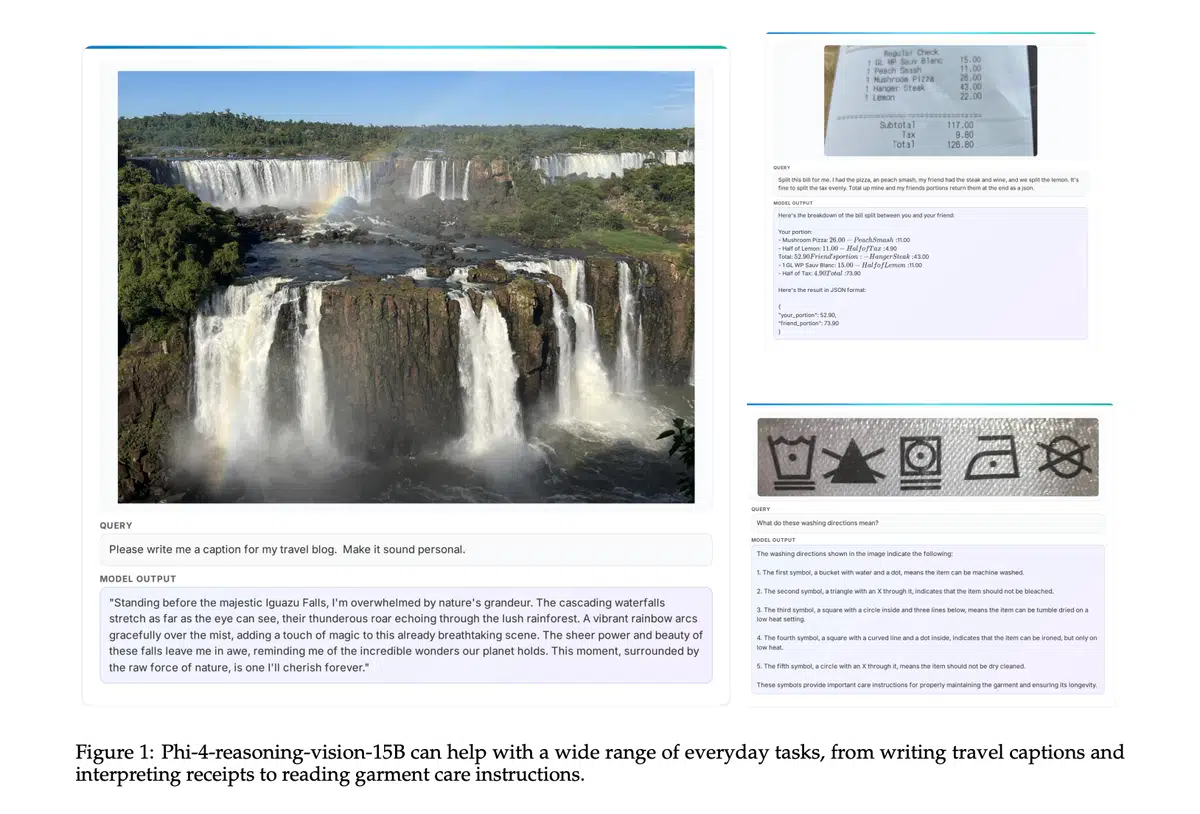

Microsoft在最新技术报告中推出 Phi-4-Reasoning-Vision-15B,是一款开放权重的多模态推理模型,规模为15 B参数。模型采用 mid‑fusion 架构:先由 SigLIP-2 视觉编码器将图像转化为视觉标记,再投射至 Phi-4‑Reasoning 语言模型的嵌入空间进行统一处理。该设计在保持跨模态推理能力的同时,显著降低了训练与推理成本。

关键技术设计

- 高分辨率动态视觉编码:支持最高 3,600 个视觉标记,能够细粒度捕捉截图、文档或界面中的小交互元素,提升 GUI 定位与文档解析的准确性。

- 混合推理与非推理训练:训练数据中约 20% 为链式推理样本,其余为感知主导任务(如图像描述、OCR、基础 VQA)。模型可在 reason 与 non‑reason 两种模式间自动切换,针对不同任务平衡响应时延与推理深度。

- 数据规模:总计 200 B 多模态标记,基于已训练的 Phi-4‑Reasoning(16 B 标记)与 Phi-4 基础模型(400 B 唯一标记)进行微调,对比近期数万亿标记的巨型模型,展现出更高的计算效率。

性能评测

在公开基准上,Phi-4-Reasoning-Vision-15B 获得以下成绩(Eureka ML Insights 与 VLMEvalKit 固定设置):

- AI2DTEST: 84.8

- ChartQATEST: 83.3

- MathVerseMINI: 44.9

- MathVisionMINI: 36.2

- MathVistaMINI: 75.2

- MMMUVAL: 54.3

- MMStar: 64.5

- OCRBench: 76.0

- ScreenSpotv2: 88.2

这些结果在 15 B 参数量级中属于领先水平,尤其在 OCR 与界面识别(ScreenSpotv2)上表现突出,验证了高分辨率感知的设计价值。

应用前景

- 科学与数学推理:模型能够直接在手写公式、图表或实验报告的图像上进行解答,适用于教育辅导、科研文献审阅等场景。

- 计算机使用代理:通过对屏幕内容的精确定位与解析,支持桌面、网页或移动端的自动化操作,满足企业内部工具自动化、无障碍辅助等需求。

- 文档智能化:在高分辨率文档(如合同、专利图纸)中实现 OCR + 结构化抽取,提升企业信息化流程的效率。

结论与展望

Phi-4-Reasoning-Vision-15B 展示了在 紧凑规模 下实现 高质量多模态推理 的可行路径。通过动态分辨率视觉编码与混合训练策略,模型在感知与推理两端实现了良好的平衡,为后续的 边缘部署 与 行业定制 奠定了基础。未来,Microsoft 计划进一步扩展训练数据多样性,并探索更细粒度的模式切换机制,以提升在复杂交互场景中的鲁棒性。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。