Goodfire完成12.5亿美元估值融资 推动AI可解释性进入软件3.0时代

融资概览

Goodfire在本轮Series B融资中获得数亿美元注资,估值提升至12.5亿美元。虽然具体投资方未全部披露,但本轮资金被视为市场对AI可解释性技术的强力背书。公司创始人Jesus Rodriguez在公告中指出,当前AI系统的黑盒特性已成为规模化部署的瓶颈,迫切需要可解释、可控的解决方案。

可解释性为何成为新焦点

过去几年,生成式大模型凭借“软件2.0”模式快速迭代——即通过海量数据和梯度下降自动学习。但这种方法让模型内部结构变得难以理解,导致 hallucination、偏见等风险难以根本治理。业界普遍把模型当作不可解释的黑盒,只能通过提示工程或RLHF(强化学习人类反馈)进行“后期调优”。

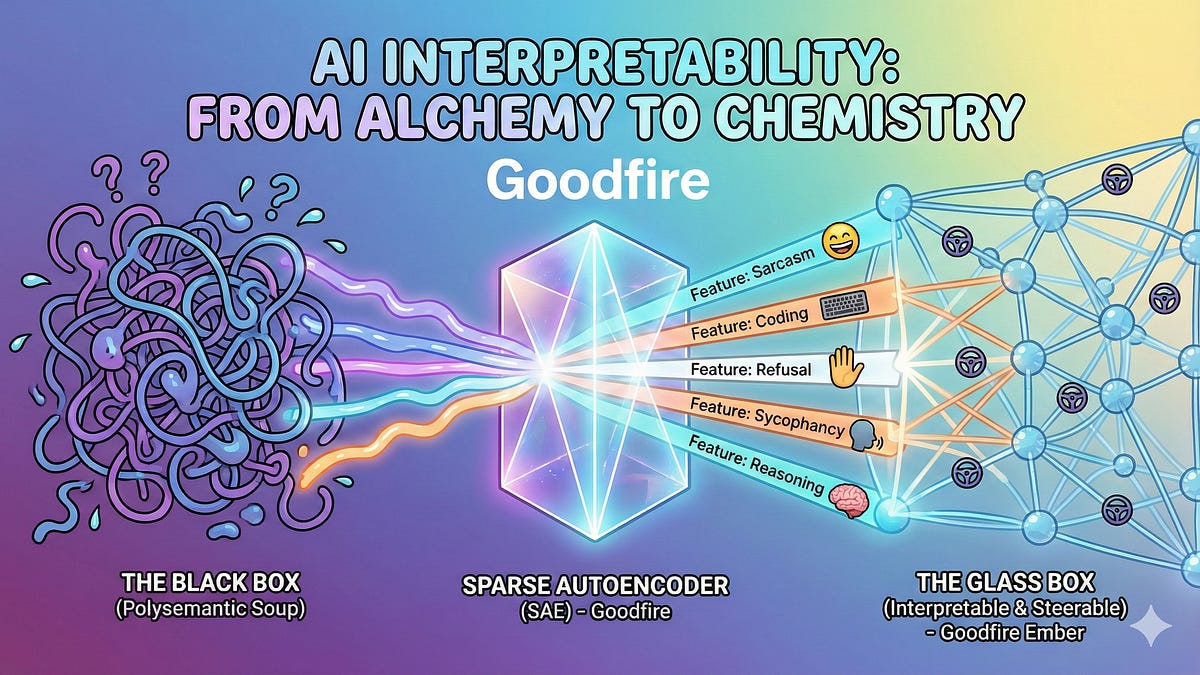

Goodfire的使命是把这种“炼金术”转变为“化学”,即通过特征引导(feature steering)和内部状态编辑(state editing),实现对模型行为的主动设计。公司将这一思路称为“软件3.0 IDE”,主张在模型训练前后都能进行可视化、可编辑的干预。

技术路径初探

- 特征引导:在模型内部识别关键特征向量,并通过约束或调节让模型在特定情境下产生期望输出。

- 代理层(Agents):在大模型之上构建可编程的代理,负责监控、纠偏以及动态调度模型子模块。

- 可解释性仪表盘:提供交互式可视化界面,帮助研发人员实时观察激活图谱、注意力分布等内部信号。

这些技术并非全新概念,但Goodfire在系统化、平台化层面的整合力度在业界少有。通过统一的IDE,研发团队可以像调试传统软件一样,对大模型的内部状态进行迭代改进。

市场与监管的双重驱动

随着生成式AI在金融、医疗、政府等高风险行业的渗透,监管机构对模型透明度提出了更高要求。欧盟的AI法案(AI Act)已明确要求提供可解释性报告,违背者将面临巨额罚款。Goodfire的技术路线恰好满足这一合规需求,为企业提供合规的AI部署方案。

与此同时,大模型提供商(如OpenAI、Google)也在陆续推出内部可解释性工具,但多为内部研发或面向特定合作伙伴。Goodfire的独立平台有望成为行业标准,实现跨模型、跨供应商的可解释性统一。

未来展望

从短期来看,Goodfire将利用新融资加速产品化,计划在2026年下半年推出Beta版IDE,面向企业客户开放。长期而言,公司希望构建“可解释性生态”,吸引第三方插件、科研机构和监管部门共同参与。若成功落地,AI可解释性将从科研话题转向生产力工具,真正进入软件工程的下一代阶段。

“我们正在从黑盒向白盒迈进,这不仅是技术突破,更是对AI安全与信任的根本重塑。”——Jesus Rodriguez,Goodfire创始人