微软发布Maia 200 AI芯片仍将采购Nvidia和AMD产品

•26 阅读•3分钟•前沿

AMDMicrosoftNvidiaMaia 200Superintelligence

Julie Bort••26 阅读•3分钟•前沿

发布概览

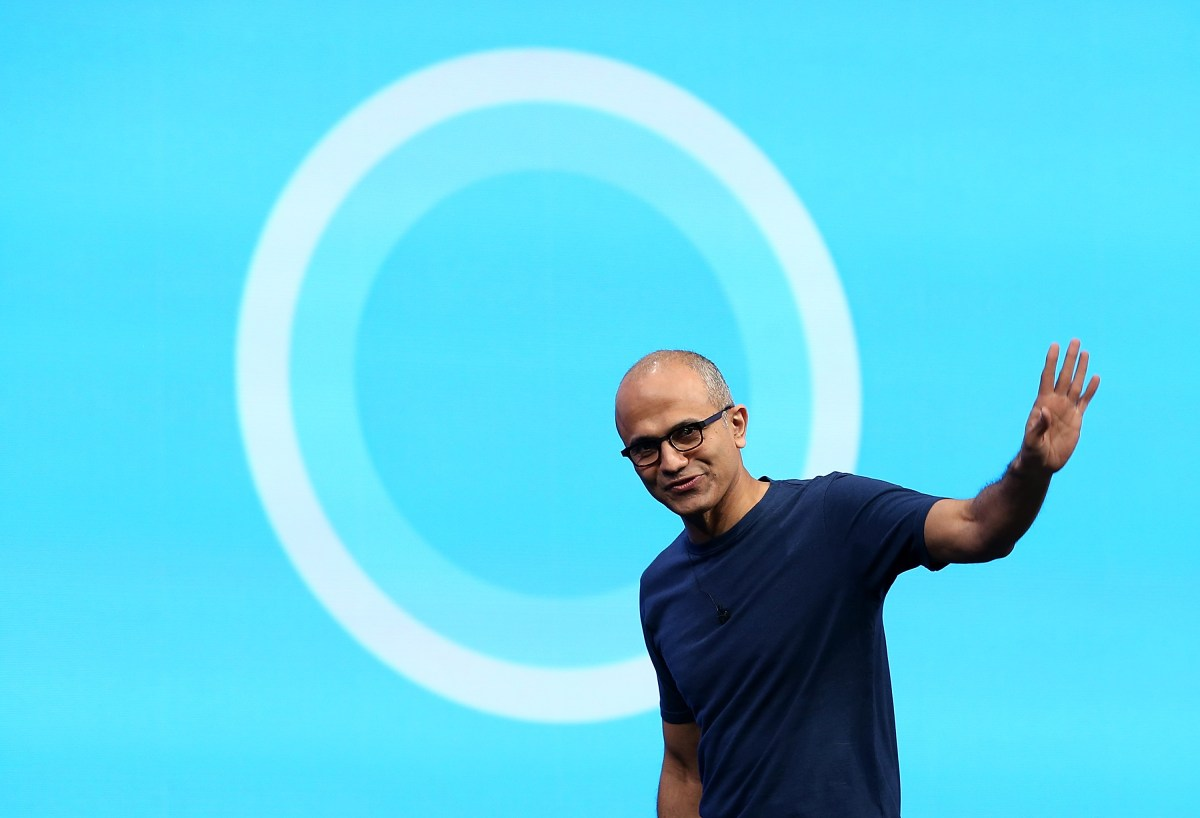

1月29日,微软在内部数据中心首次部署自研AI推理芯片Maia 200。该芯片定位为“AI推理强机”,旨在提升大模型在生产环境中的响应速度与能效。与此同时,CEO萨德尔娜在公开访谈中强调,微软不会放弃与Nvidia、AMD的合作,仍将采购这些厂商的AI芯片以满足多样化算力需求。

芯片技术规格

- 名称:Maia 200

- 定位:AI推理加速器,针对大规模语言模型和多模态模型进行深度优化。

- 性能对比:官方声称在相同工作负载下,Maia 200的吞吐量比亚马逊最新的Trainium提升约15%,比谷歌的最新TPU提升约12%。

- 制程:采用台积电5nm工艺,集成超过30 000个自定义算子单元。

- 功耗:在峰值推理场景下,功耗比同类GPU降低约20%。

战略意义

- 垂直整合:微软通过自研芯片实现从硬件到云服务的全链路控制,降低对单一供应商的依赖。

- 模型自主:Maia 200将优先供给微软内部的Superintelligence团队,该团队由前DeepMind联合创始人Mustafa Suleyman领衔,负责研发微软自有的前沿大模型,以期在未来降低对OpenAI、Anthropic等外部模型提供商的依赖。

- 保持弹性:萨德尔娜指出,“垂直整合并不意味着完全自给自足”,继续采购Nvidia和AMD的AI芯片是为了在供应链紧张时确保算力供给,并借助这些厂商的创新保持竞争优势。

市场与合作

- 合作伙伴:微软重申与Nvidia、AMD的“伟大合作”,双方在AI加速器、驱动软件以及云原生工具方面保持同步研发。

- 生态布局:Maia 200将兼容Azure上的OpenAI模型,帮助客户在Azure上获得更低的推理成本与更高的响应速度。

- 行业影响:随着亚马逊、谷歌等竞争对手也在加速自研芯片布局,微软的双轨策略凸显了大型云厂商在AI算力争夺战中的多元化路径。

“我们与Nvidia、AMD的合作仍在继续,创新永不止步,”萨德尔娜在接受媒体采访时如是说。

展望

Maia 200的正式投产标志着微软在AI硬件领域迈出关键一步,但其是否能在实际业务中实现预期的性能提升仍需时间检验。业界将密切关注Superintelligence团队利用该芯片训练的下一代前沿模型,以及微软在云服务定价和算力供应上的后续布局。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。