NVIDIA发布Cosmos Policy机器人控制模型,刷新操控基准

•22 阅读•3分钟•前沿

NVIDIACosmos PolicyLIBERORoboCasa

•22 阅读•3分钟•前沿

背景与创新

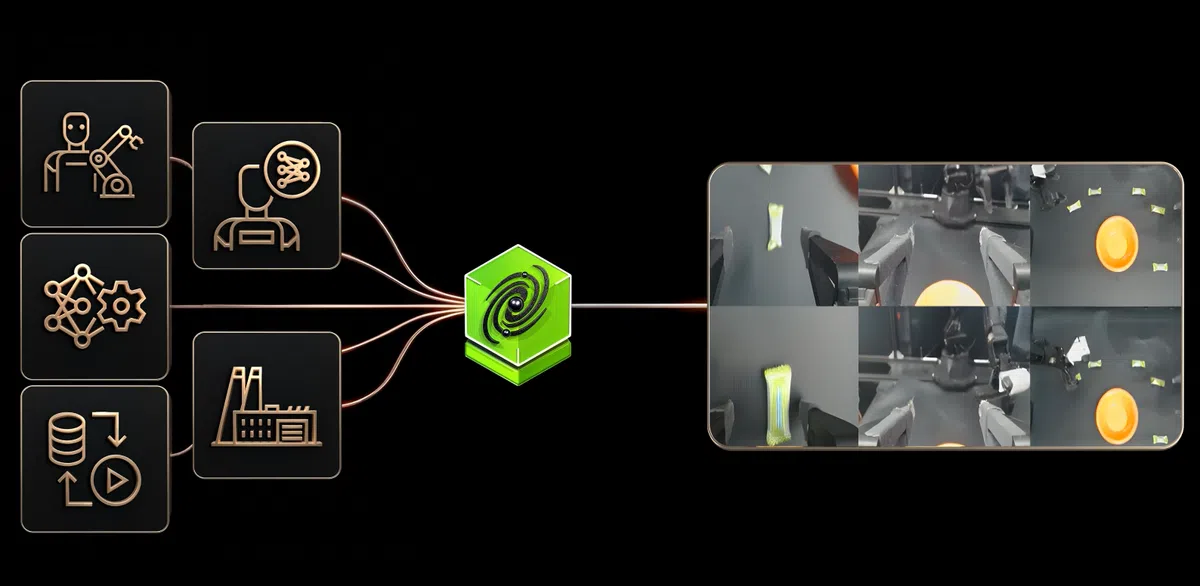

NVIDIA 近日在 Hugging Face 官方博客发布 Cosmos Policy,这是一种面向机器人操作与规划的控制策略。该策略通过对已发布的世界基础模型 Cosmos Predict‑2 进行单阶段后训练,将机器人动作、物理状态以及成功评分视作视频帧的潜在表示,直接注入模型的扩散过程,实现了“感知‑决策‑执行”三位一体的统一建模。

关键技术

- 帧式动作编码:动作、观测与价值均以潜在帧形式加入时间序列,模型无需额外的感知或控制子网络。

- 扩散式多模态生成:借助原始视频预测的扩散目标,模型自然掌握重力、碰撞等物理规律,可生成多样的动作序列。

- 统一 Transformer 解码器:同一解码器负责动作块、未来观测与价值预测,支持长序列并行推理。

实验结果

Cosmos Policy 在两大机器人操控基准上实现了显著提升:

- LIBERO(多任务长时序操控)平均成功率 98.5%,在空间、目标、长程子任务上均突破 97% 大关。

- RoboCasa(家庭场景操作)在仅 50 条演示数据的设置下达到 67.1%,领先同类视频政策与 VLA 方法 5% 以上。

“Cosmos Policy 的优势来源于对预训练时空动态的完整继承,而非单纯的感知‑动作映射。”—— NVIDIA 研发团队

部署模式

- 直接控制:推理时仅输出动作序列,实时性佳,已在 NVIDIA ALOHA 双臂平台上完成长时序任务。

- 基于模型的规划:生成多组候选动作并预测其后续状态与价值,可提升约 12.5% 的任务完成率,适用于高风险或需要精细调优的场景。

生态与社区活动

为加速物理 AI 的落地,NVIDIA 同时启动了 Cosmos Cookoff 黑客松(2026‑01‑29 至 2026‑02‑26),提供 $5,000 现金奖、DGX Spark™、RTX 5090 GPU 等资源。参赛团队将围绕机器人、自动驾驶及视频分析等方向,利用 Cosmos 系列模型与 Cookbook 示例快速原型。评审阵容包括 Datature、Nebius、Nexar 等业界专家。

Cosmos Policy 已在 Hugging Face Model Hub 开源发布,配套代码同步至 GitHub,开发者可即刻下载模型卡,复现论文实验或在自有平台上进行二次开发。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。