DeepMind推出D4RT实现300倍速4维场景重建与追踪

•31 阅读•2分钟•前沿

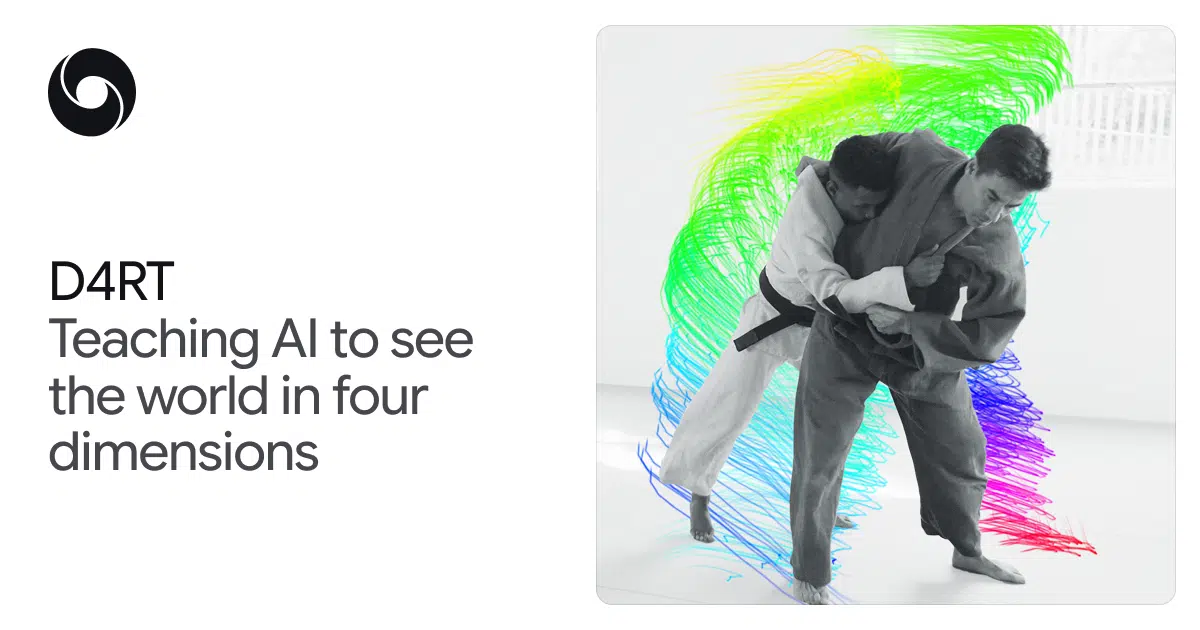

DeepMind4D重建动态场景实时感知空间计算

•31 阅读•2分钟•前沿

背景与挑战

传统的4D(空间 + 时间)场景重建依赖多套专门模型:深度估计、运动估计、相机位姿恢复等,各自计算量大且难以协同。面对视频中物体遮挡、快速运动以及相机抖动,现有方法往往出现碎片化重建或严重延迟,难以满足实时交互的需求。

D4RT核心原理

D4RT 采用统一的 Encoder‑Decoder Transformer 架构,核心创新在于 查询驱动 的处理方式:

- 单一查询:模型只需回答“该像素在任意时间、任意相机视角下的3D坐标”。

- 并行解码:数千个查询可同步在现代 AI 加速器上执行,实现毫秒级响应。

- 全局压缩表征:Encoder 将整段视频压缩为统一的几何‑运动表征,Decoder 依据查询即时提取所需信息。

性能与评估

- 速度:在单块 TPU 上,处理 1 分钟视频仅需约 5 秒,较前沿方法快 18–300 倍。

- 精度:在 MPI‑Sintel、Aria Digital Twin 以及 RE10k 数据集上,D4RT 在点云重建、像素追踪和相机位姿估计等指标上均刷新最高记录。

- 鲁棒性:即使目标在部分帧中完全不可见,模型仍能预测其连续轨迹,显著降低遮挡导致的错误。

下游应用前景

- 机器人:提供动态环境的实时空间映射,提升导航与操作安全性。

- 增强现实 (AR):低延迟的几何感知使得 AR 眼镜能够在设备端完成对象遮挡与交互渲染。

- 世界模型:通过解耦相机运动与物体运动,D4RT 为通用人工智能构建更完整的物理世界模型奠定基础。

“我们不必在准确性和效率之间做选择,D4RT 让两者兼得,为空间计算打开新局面。” — DeepMind 研究团队

未来,DeepMind 将继续优化模型规模与硬件适配,推动 D4RT 在移动端和嵌入式系统中的落地。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。