Microsoft推出OrbitalBrain 将卫星星座变为分布式机器学习平台

•34 阅读•4分钟•前沿

MicrosoftOrbitalBrain卫星星座分布式机器学习ISL

•34 阅读•4分钟•前沿

背景与挑战

地球观测(EO)星座每天产生数十万张高分辨率影像,但下行带宽是主要瓶颈。以Planet类似的207颗卫星、12个地面站为例,日均捕获约363,563张300 MB图像,实际可下行仅约42,384张(约11.7%),即使压缩至100 MB也只能下行约111,737张(30.7%)。大量新鲜样本因存储受限而被迫删除,导致地面模型只能基于延迟和不完整的数据进行训练。

传统联邦学习的局限

研究团队尝试了AsyncFL、SyncFL、FedBuff、FedSpace等联邦学习基线,却发现卫星的间歇性连通、功耗约束以及非独立同分布(non‑i.i.d.)的数据分布,使得模型收敛不稳定,精度下降10%‑40%。在轨更新的时效性无法满足实时监测需求。

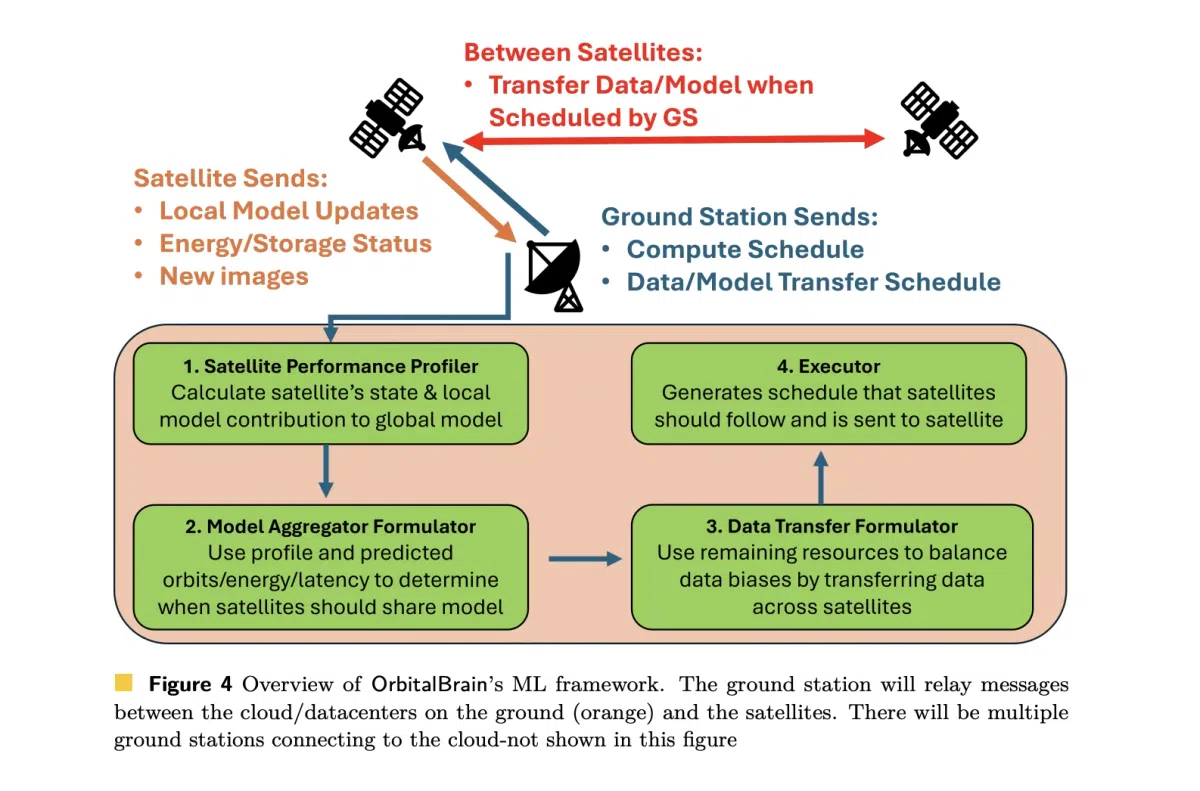

OrbitalBrain 框架核心

OrbitalBrain 以星座为中心重新设计训练流程,提出三类可调度动作:

- 本地计算(LC):在卫星搭载的NVIDIA Jetson Orin Nano GPU上对本地存储的影像进行模型微调。

- 模型聚合(MA):利用星间链路(ISL)在卫星之间交换模型参数,实现近实时的去中心化聚合。

- 数据转移(DT):在卫星之间传输原始图像,平衡标签分布,缓解非 i.i.d. 带来的偏差。

云端调度器基于轨道预测、功率模型、存储容量和链路可视性,为每颗卫星生成未来窗口的最优动作序列。调度目标是最大化计算效用‑‑通过引导式性能分析器评估模型陈旧度与损失,动态决定 LC、MA 或 DT 的优先级。

实验设置与结果

- 仿真平台:Python 实现的 CosmicBeats 轨道模拟器 + FLUTE 联邦学习框架。

- 硬件模型:NVIDIA‑Jetson‑Orin‑Nano‑4GB GPU。

- 数据集:fMoW(360k RGB 图像,62 类)和 So2Sat(400k 多光谱图像,17 类)。

- 对比基线:BentPipe(仅下行)、AsyncFL、SyncFL、FedBuff、FedSpace。

| 星座 | 数据集 | OrbitalBrain Top‑1 精度 | 最佳基线提升 | 时间加速 |

|---|---|---|---|---|

| Planet | fMoW | 52.8% | +5.5%‑49.5% | 1.52×‑12.4× |

| Spire | fMoW | 59.2% | 同上 | 同上 |

| Planet | So2Sat | 47.9% | +8.3% | 2.1× |

| Spire | So2Sat | 47.1% | +7.9% | 2.0× |

消融实验显示,去除模型聚合或数据转移均会导致收敛速度和最终精度显著下降,验证了三项动作协同的重要性。

实际意义

OrbitalBrain 证明了卫星星座可以从单纯的数据采集者转变为分布式机器学习平台。通过在轨训练并即时更新模型,可为森林火灾检测、洪涝监测、气候分析等时效性强的遥感任务提供更鲜活的模型,缩短从观测到决策的链路。

展望

随着星间链路速率提升和更强的在轨计算芯片落地,OrbitalBrain 的调度算法有望进一步扩展到更大规模的星座,甚至实现跨运营商的协同学习,为太空 AI 应用打开新局面。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。