NVIDIA发布C‑RADIOv4统一视觉骨干网络,兼容分类、密集预测与分割任务

•66 阅读•4分钟•前沿

NVIDIAC‑RADIOv4SigLIP2DINOv3SAM3

•66 阅读•4分钟•前沿

背景与创新

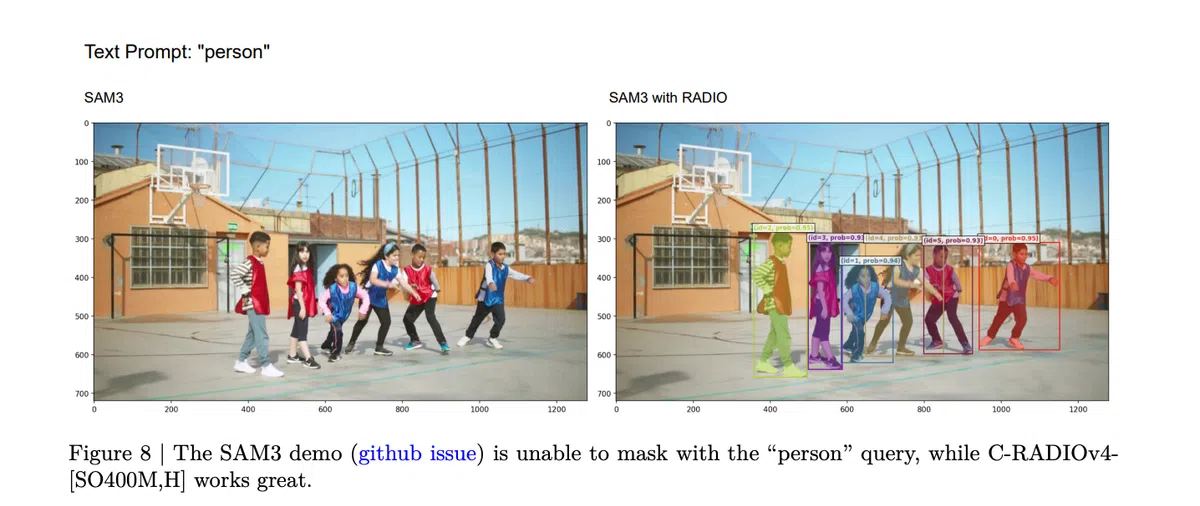

NVIDIA AI 最近在 arXiv 上发布了 C‑RADIOv4,一种面向大规模视觉任务的聚合蒸馏骨干网络。该模型在前代 RADIO 系列的基础上,首次同时蒸馏三类强教师——视觉语言模型 SigLIP2‑g‑384、密集自监督模型 DINOv3‑7B,以及分割专用模型 SAM3,实现“一网打尽”分类、检索、密集预测和分割四大任务。

技术细节

- 聚合蒸馏架构:单一 ViT‑style 学生网络同时匹配教师模型的稠密特征图(DINOv3、SAM3)和摘要 token(SigLIP2、DINOv3),实现多任务兼容。

- 教师升级:

- SigLIP2‑g‑384 提升图文对齐能力;

- DINOv3‑7B 产生高质量自监督稠密特征;

- SAM3 提供分割导向的特征并兼容 SAM3 解码器。

- 随机多分辨率训练:输入尺寸在 128‑1152 像素之间随机抽样,低分辨率集合 {128,192,224,256,384,432}、高分辨率集合 {512,768,1024,1152},显著平滑不同分辨率下的性能曲线。

- 噪声抑制机制:

- Shift‑Equivariant Dense Loss:学生与教师在不同平移裁剪后对齐特征,仅在重叠区域计算误差,防止记忆教师的绝对位置噪声。

- Shift‑Equivariant MESA:在线网络与 EMA 副本同样使用平移对齐,提升鲁棒性并保持平滑的损失景观。

- 角度归一化摘要损失:根据教师嵌入在球面上的角度离散度对余弦距离进行归一化,平衡 SigLIP2(聚焦窄锥)与 DINOv3(分散球面)的贡献。

性能与评测

- ImageNet‑1K 零样本分类:C‑RADIOv4‑H 达到 83.09% Top‑1,超过 RADIOv2.5‑H,且在 1024px 附近表现最佳。

- ADE20K 稠密预测:在 512px、1024px、1536px 分辨率下分别获得 55.20、57.02、57.72 mIoU,逼近 DINOv3‑7B 的标尺,但参数量仅为其约十分之一。

- 其他基准:VOC 87.24 mIoU、NAVI 63.44、SPair 60.57,均领先前代 RADIO 模型。

- 多分辨率稳健性:与 DINOv3‑7B 在低分辨率下的性能下降形成鲜明对比,C‑RADIOv4 在高分辨率持续提升。

部署与实用性

C‑RADIOv4 设计为 SAM3 感知编码器的直接替换版,保持 SAM3 解码器和记忆模块不变。提供 ViTDet‑mode 配置,窗口注意力大小支持 6×6 至 32×32,兼容 A100 上的高效推理。SO400M 小模型在窗口尺寸 ≤12 时比 SAM3 ViT‑L+ 编码器更快;Huge 模型在窗口尺寸 8 时延迟相近,证明其在实际高分辨率密集任务中的可部署性。

关键要点

- 单一骨干统一三大任务,实现跨模态、跨分辨率的高效推理;

- 随机多分辨率训练与 FeatSharp 上采样保证低高分辨率表现均衡;

- Shift‑Equivariant 损失抑制教师噪声,提升模型泛化;

- 角度归一化摘要损失平衡视觉语言与稠密特征贡献;

- 开源模型遵循 NVIDIA Open Model License,可直接用于科研和商业部署。

“C‑RADIOv4 展示了聚合蒸馏在视觉大模型时代的可行路径,为多任务统一提供了新的参考范式。”

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。