美国国防部将Anthropic列为供应链安全风险 引发AI行业争议

•6 阅读•3分钟•视野

ClaudeAnthropicAI安全美国国防部

•6 阅读•3分钟•视野

背景

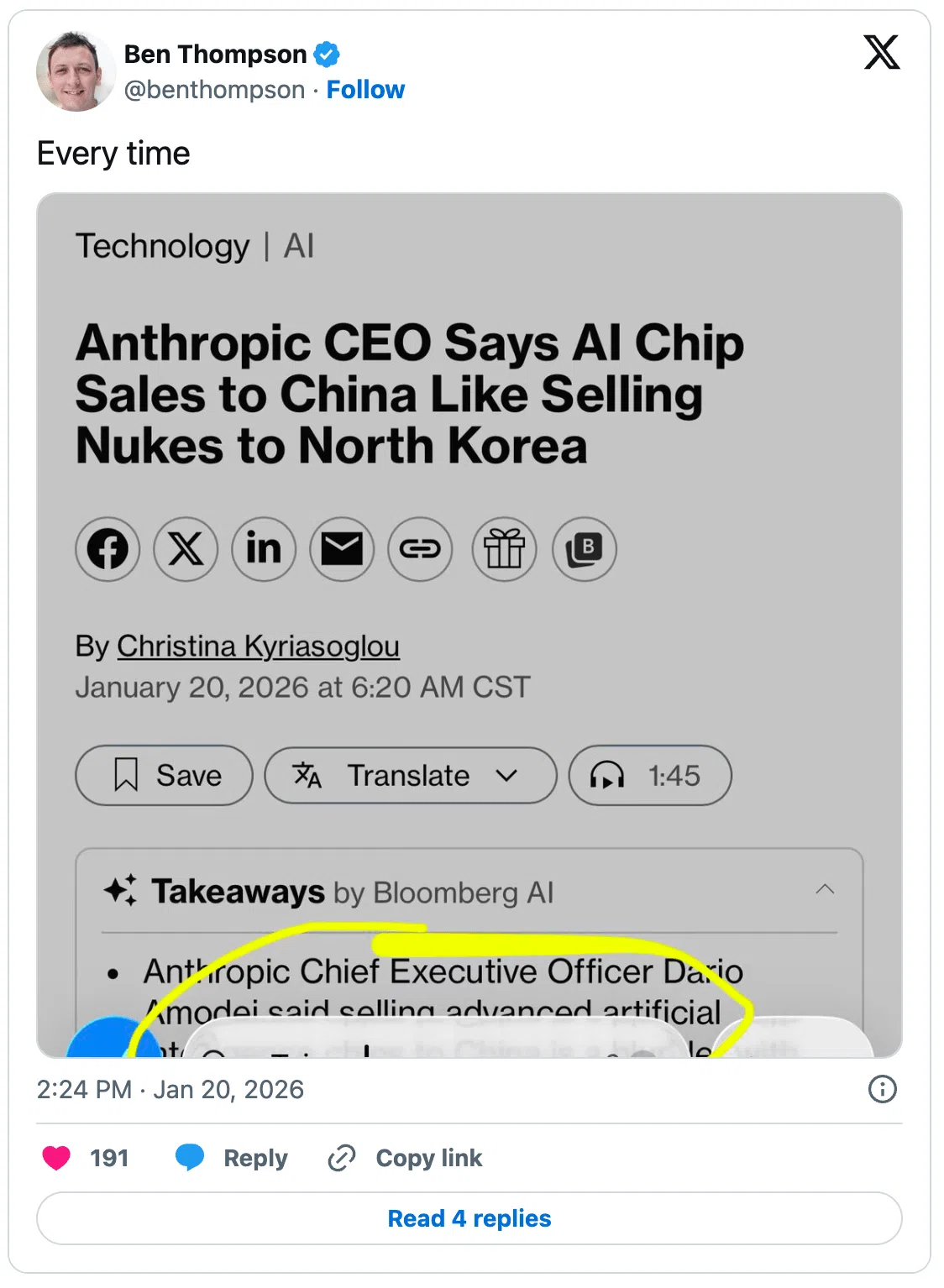

美国国防部(DoD)近期对AI供应链安全展开审查,依据《国防生产法》将部分技术公司列入风险名单。2026年3月初,国防部发布声明,指Anthropic的AI模型在未经充分监管的情况下可能被用于大规模国内监控和全自主武器系统,因而将其标记为“供应链安全风险”。同日,Anthropic创始人兼CEO Dario Amodei通过官方声明回应,重申公司对上述两类用例的零容忍态度。

关键进展

- 官方声明:国防部部长Pete Hegseth在X(Twitter)上表示,所有与美国军方有业务往来的供应商必须接受“任何合法用途”,若Anthropic坚持其安全限制,将被立即剔除。

- Anthropic立场:Amodei指出,AI在“局部、受控的情境下”可用于合法情报与反情报任务,但大规模国内监控与全自主武器超出技术安全边界,不能被纳入合同。

- 竞争格局:同一时间,OpenAI宣布已与国防部达成协议,其模型将在受限的机密环境中使用,成为唯一未受Anthropic限制的供应商。

Anthropic的安全原则

“在狭窄的案例中,我们相信AI可能削弱而非捍卫民主价值。”

Anthropic在声明中列出两大例外:

- 大规模国内监控:AI能够将分散的公开数据自动聚合,形成对个人的全景画像,违背基本自由。

- 全自主武器:当前前沿AI系统仍不具备可靠的目标识别与决策能力,直接交付致命武器将带来不可接受的风险。

公司同时提出愿意与国防部合作研发更可靠的系统,但前提是必须设立严格的监督与人工干预机制。

行业影响

- 供应链冲击:Anthropic的主要云服务提供商包括AWS、Microsoft和Google,这些平台均与国防部有大量合同。若Anthropic被排除,相关云服务的军方业务可能受到连锁影响。

- 监管趋势:此次事件标志着美国政府对AI技术的安全审查进入新阶段,未来可能出现更多针对模型使用场景的合规要求。

- 竞争者机会:OpenAI凭借与国防部的合作,将在军用AI市场获得先机,可能加速其在政府部门的渗透。

前景展望

- 政策层面:国会可能会进一步立法,明确AI在国防领域的使用边界,推动更透明的审计机制。

- 技术层面:Anthropic可能加速研发可解释性与安全性更高的模型,以满足日益严格的合规需求。

- 市场层面:AI初创企业需重新评估与政府合作的风险与收益,尤其是在涉及高敏感度技术的项目上。

此次冲突不仅是一次企业与政府的利益博弈,也折射出AI技术在国家安全与民主价值之间的复杂平衡。未来,如何在保持创新活力的同时,构建可靠的监管框架,将成为行业长期关注的核心议题。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。