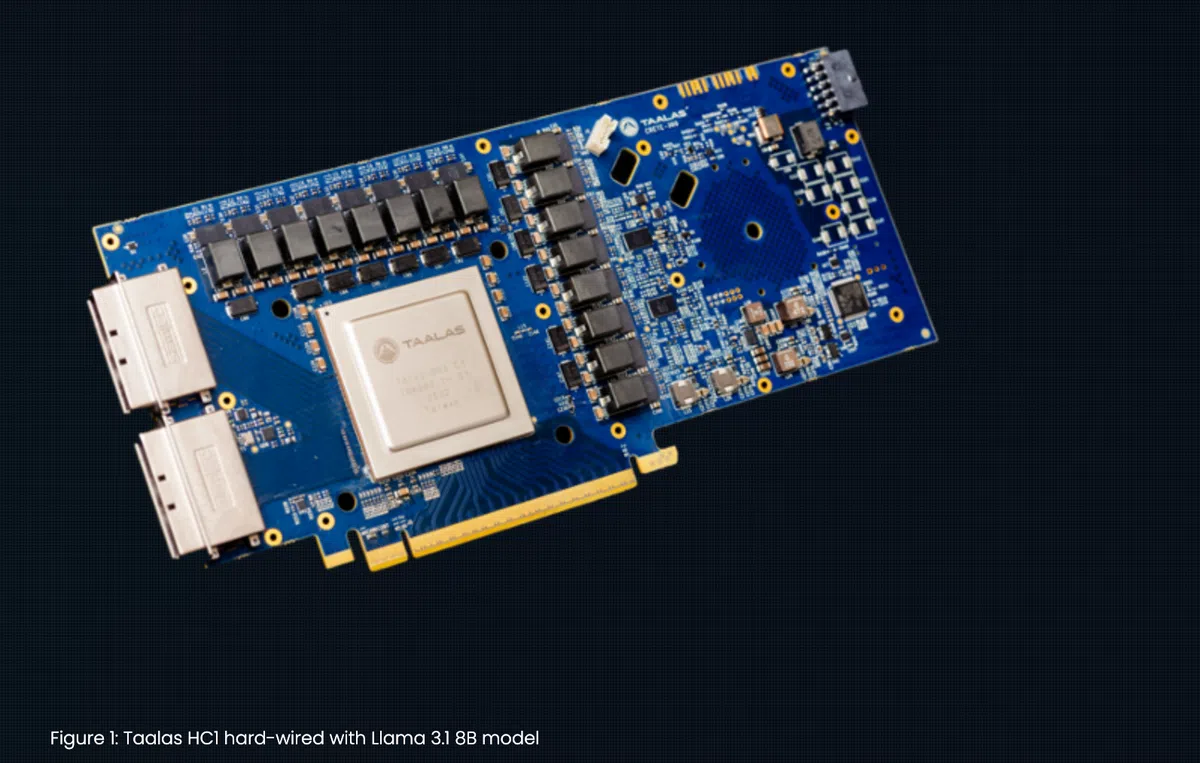

Taalas发布硬连线AI芯片HC1 单卡突破每秒17000令牌 让推理成本骤降

•21 阅读•3分钟•视野

NVIDIATaalasHC1Llama 3.1ASIC

•21 阅读•3分钟•视野

背景

在AI基础设施领域,通用GPU长期被视为唯一的推理平台,因为模型更新频繁,业界相信可编程性是必需的。然而,Taalas创始团队认为,正是这种灵活性限制了成本和能效的进一步下降。公司提出“硬连线”(hardwired)概念:把特定模型的权重和计算图直接刻进硅片的金属层,彻底消除传统GPU的指令集和内存搬运开销。

HC1 芯片亮点

- 吞吐量:在演示中,HC1 运行 Llama 3.1 8B 时实现 16,000‑17,000 令牌/秒,相当于顶级 NVIDIA H100 单卡的 100 倍以上。

- 能效提升:公司声称相较于通用GPU,HC1 在功耗和成本上实现约 1,000 倍的提升。

- 硬件简化:由于权重已固化在芯片内部,省去高带宽内存(HBM)和复杂液冷系统,一块 250W 卡即可在普通风冷机箱中部署十张卡的算力。

自动化“权重‑硅”制程

传统 ASIC 设计周期往往需要两年、数千万美元的投入。Taalas 研发的编译式制程将模型权重直接转换为版图,仅需更换顶层金属掩模即可完成生产。整个“权重‑硅”流程约两个月完成,其中模型到芯片的设计时间压缩至一周,解决了硬件专用化与模型迭代之间的矛盾。

"如果我们想让AI像塑料一样普及,就必须把‘模拟’的智能直接‘铸造’进硅片。"——Taalas 首席技术官

市场与产业影响

Taalas 的硬连线思路标志着 AI 产业链的分层转型:

- 训练阶段仍由 NVIDIA、AMD 等提供大规模、可编程的 GPU 集群支撑。

- 推理阶段则可能被专用 ASIC 主导,成本只剩下每令牌的微小费用。

如果 HC1 能在智能手机、工业传感器等终端实现大规模部署,AI 推理将从云端迁移到本地,延迟几乎为零,且无需持续订阅费用。这将进一步推动生成式AI在边缘设备上的落地,加速“Device‑Native AI”时代的到来。

挑战与前景

硬连线芯片的最大风险在于模型更新的频率。虽然 Taalas 声称其自动化流水线可以实现季节性硬件迭代,但相较于软件升级仍存在时间和成本壁垒。行业观察人士预计,短期内硬件专用化将集中在高流量、对成本极度敏感的应用场景,如搜索、客服和实时翻译;而通用模型的研发仍依赖灵活的 GPU 平台。

总体来看,Taalas 的 HC1 为 AI 推理成本的根本性突破提供了可行路径,也预示着硬件与模型协同设计将成为下一轮竞争的焦点。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。