Sakana AI推出Doc‑to‑LoRA与Text‑to‑LoRA 实现零样本长文档内化与即时模型适配

•7 阅读•2分钟•前沿

LoRASakana AIPerceiver零样本

•7 阅读•2分钟•前沿

背景

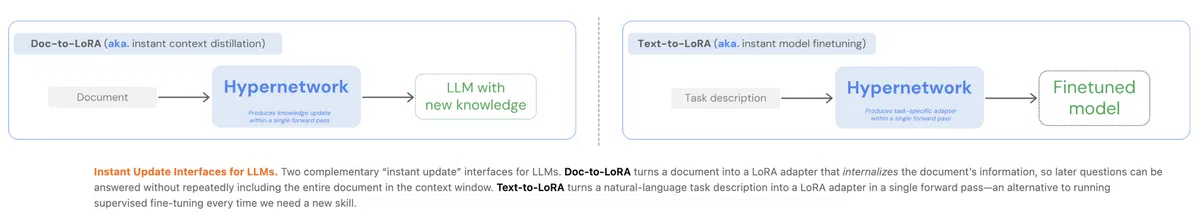

大语言模型(LLM)的定制一直在灵活性与效率之间权衡。传统的**上下文学习(ICL)**受限于二次注意力成本,随提示长度线性增长的 KV‑cache 导致延迟与显存飙升;**上下文蒸馏(CD)和监督微调(SFT)**虽能将知识写入模型参数,却需要高昂的训练开销和较长的更新时延。Sakana AI 通过一次性元训练费用,研发出两种超网络——Text‑to‑LoRA(T2L) 与 Doc‑to‑LoRA(D2L),实现即插即用的模型适配。

技术概览

Text‑to‑LoRA (T2L)

- 任务编码:使用任务描述文本的编码器提取向量,结合可学习的模块与层嵌入,喂入多层 MLP 生成 LoRA 的 A、B 矩阵。

- 训练方式:① LoRA 重构——将已有 LoRA 适配器蒸馏进超网络;② 端到端 SFT——在多任务数据集上共同优化超网络。

- 效果:在 GSM8K、Arc‑Challenge 等基准上,T2L 与专属任务适配器持平或略优,且相较于 3‑shot ICL 将适配成本降低超 4 倍。

Doc‑to‑LoRA (D2L)

- 感知器跨模态架构:采用 Perceiver‑style 跨注意力,将基模型的可变长 token 激活映射为固定形状 LoRA。

- 分块机制:将超长文档切分为 K 块,分别生成局部 LoRA,再在秩维度上拼接形成高秩适配器,保持网络输出形状不变。

- 零样本长文档:在 Needle‑in‑a‑Haystack 检索任务中,D2L 对 4 倍于基模型窗口的上下文仍保持近乎完美的准确率。

性能与效率

- 显存节省:处理 128K token 文档时,传统 KV‑cache 需 >12 GB 显存,D2L 仅使用 <50 MB。

- 更新时延:内部化过程 <1 秒,远快于 CD 的 40‑100 秒。

- 跨模态迁移:将视觉语言模型(VLM)输出的激活映射至文本 LLM,令后者在 Imagenette 图像分类上达到 75.03% 的零样本准确率,展示了视觉信息的参数化可能性。

影响与展望

Sakana AI 的超网络方案为 LLM 定制提供了一次性付费、即时部署的全新范式。对企业而言,可在不牺牲算力的前提下快速集成新业务需求;对研究者而言,提供了长上下文内部化的可复现基线,进一步推动 零样本任务适配 与 跨模态知识迁移 的探索。后续工作可能聚焦于更大规模的感知器模型、对话式交互的实时适配以及开放源码社区的生态建设。

“通过把长文档固化进模型权重,我们实现了从‘记忆’到‘知识’的跨越。” – Sakana AI 项目负责人

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。