Guide Labs发布Steerling-8B:首款可追溯的开源可解释大模型

•18 阅读•3分钟•前沿

开源模型Guide LabsSteerling-8B可解释性

Tim Fernholz••18 阅读•3分钟•前沿

背景

Guide Labs是一家由前MIT博士Julius Adebayo和首席科学官Aya Abdelsalam Ismail创立的AI初创公司。公司近期完成了9 百万美元的种子轮融资,并在Y Combinator孵化。此次发布的Steerling-8B是公司迄今为止规模最大的模型,也是首个在开源社区公开的可解释大模型。

新架构亮点

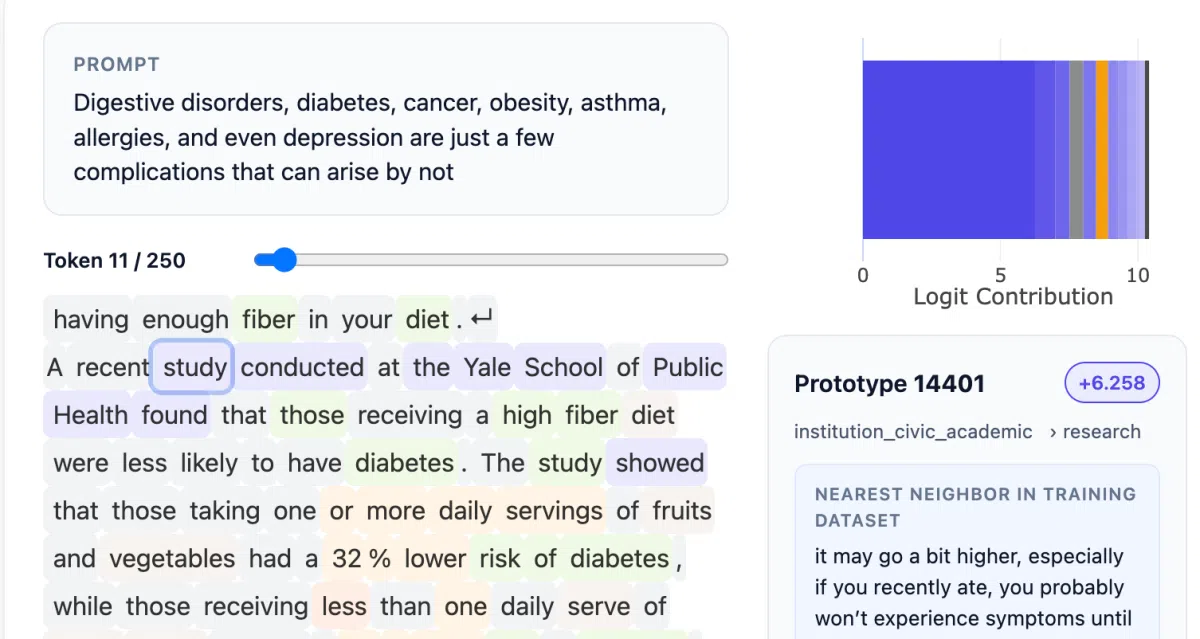

- 概念层(Concept Layer):在模型内部插入专门的概念层,将训练数据按语义类别进行分桶,实现每个token的来源可追溯。

- 可解释性追溯:用户可查询模型引用的原始文献、事实来源,甚至对模型的性别、幽默等抽象概念进行细粒度检查。

- 数据标注自动化:利用现有AI模型辅助标注,大幅降低了上游标注成本,使得大规模可解释训练成为可能。

性能与应用

Guide Labs称Steerling-8B在常规基准上达到现有同等规模模型的约90%性能,但只用了更少的训练数据。其可解释特性为以下场景提供了突破:

- 合规监管:金融、医疗等受监管行业可通过追溯机制确保模型不使用受限数据或产生违规输出。

- 科研透明:在蛋白质折叠、材料发现等前沿科学中,研究者能够了解模型为何给出特定预测,从而提升信任度。

- 内容审查:通过精准锁定模型内部的敏感概念,实现对暴力、毒品等内容的细粒度过滤。

市场与前景

Steerling-8B的开源发布为社区提供了可直接部署的可解释模型基线,预计将刺激更多企业在产品化阶段加入可解释层。Guide Labs计划在今年下半年推出更大规模的Steerling系列,并提供基于API的可解释服务,帮助企业在AI治理方面快速落地。

结语

从“神经科学式”后置解释到“工程化”自底向上可解释,Steerling-8B标志着可解释AI正从科研概念走向可商用工程。随着监管压力和行业对透明度的需求增长,这类模型有望成为下一代生成式AI的标准配置。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。