NVIDIA发布DreamDojo开源机器人世界模型 实现44千小时人类视频预训练

•25 阅读•4分钟•前沿

NVIDIA开源机器人DreamDojo

•25 阅读•4分钟•前沿

背景与意义

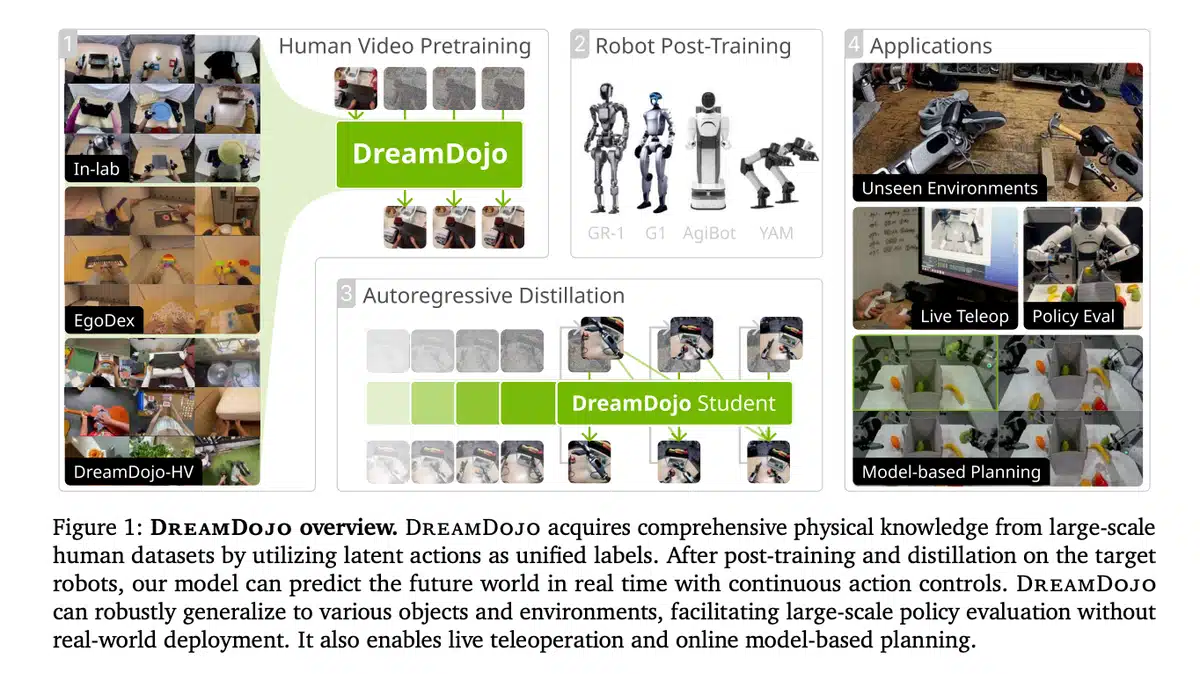

机器人仿真长期受制于传统物理引擎的繁琐建模和高昂算力成本。NVIDIA推出的DreamDojo通过像素级“梦境”预测取代显式物理计算,借助大规模人类视频赋予机器人对真实世界的常识理解,标志着机器人模拟进入数据驱动的新时代。

数据规模与多样性

- 数据集:DreamDojo‑HV,44,711 小时的第一人称人类视频

- 任务数:6,015 项独立任务,覆盖 1M+ 轨迹

- 场景与物体:9,869 种场景,43,237 种独特物体

如此规模的多样化经验让模型在学习倒泼液体、折叠衣物等复杂物理时具备“常识”。

架构创新

DreamDojo 基于 Cosmos‑Predict2.5 潜在视频扩散模型,核心改进包括:

- 相对动作 (Relative Actions):使用关节增量而非绝对姿态,提高跨机器人通用性。

- 块状动作注入 (Chunked Action Injection):在每个潜在帧中注入 4 帧连续动作,与 WAN2.2 tokenizer 的时间压缩率保持一致,消除因因果顺序导致的混乱。

- 时序一致性损失 (Temporal Consistency Loss):匹配预测帧速度与真实转移,显著降低视觉伪影并保持物体运动的物理一致性。

连续潜在动作的抽取

人类视频缺乏机器人级的动作标签。NVIDIA 引入时空 Transformer VAE,将相邻两帧压缩为 32 维潜在向量,作为最关键的运动信息。该信息瓶颈实现了动作与视觉上下文的解耦,使模型能够从人类行为中学习通用物理规律,再迁移至不同机器人体态。

实时性能 via Self‑Forcing 蒸馏

标准扩散模型需要数十步去噪,难以满足交互需求。团队在 64 块 NVIDIA H100 上进行自强蒸馏,将去噪步数从 35 降至 4,最终模型达到 10.81 FPS,并可稳定滚动 60 秒(600 帧)以上。

下游应用场景

- 可靠的策略评估:模拟成功率与真实世界 Pearson 相关系数 0.995,MMRV 仅 0.003。

- 模型‑基规划:在水果包装任务中使用 DreamDojo 进行前瞻模拟,实测真实成功率提升 17%,采样效率提升 2 倍。

- 实时远程操控:研发者利用 PICO VR 控制器在本地 RTX 5090 机器上实现虚拟机器人实时遥控,快速安全地收集新数据。

开源与生态

NVIDIA 已发布全部模型权重、训练代码及评估基准,研究者可在自己的机器人数据上进行后训练,进一步推动机器人通用感知与控制的社区协作。

"DreamDojo 将机器人仿真从手工物理转向大规模人类经验学习,为通用机器人智能奠定数据基础。" — NVIDIA 机器人研究团队

结语

DreamDojo 的发布展示了 AI 在机器人感知与控制领域的跨模态突破。凭借前所未有的数据规模、创新的潜在动作代理以及实时蒸馏加速,它不仅为学术研究提供了高保真基准,也为工业落地提供了可直接使用的开源工具,预示着机器人系统从模拟走向真实的关键一步。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。