OpenAI发布Codex macOS应用 加速代理式编程突破

发布概览

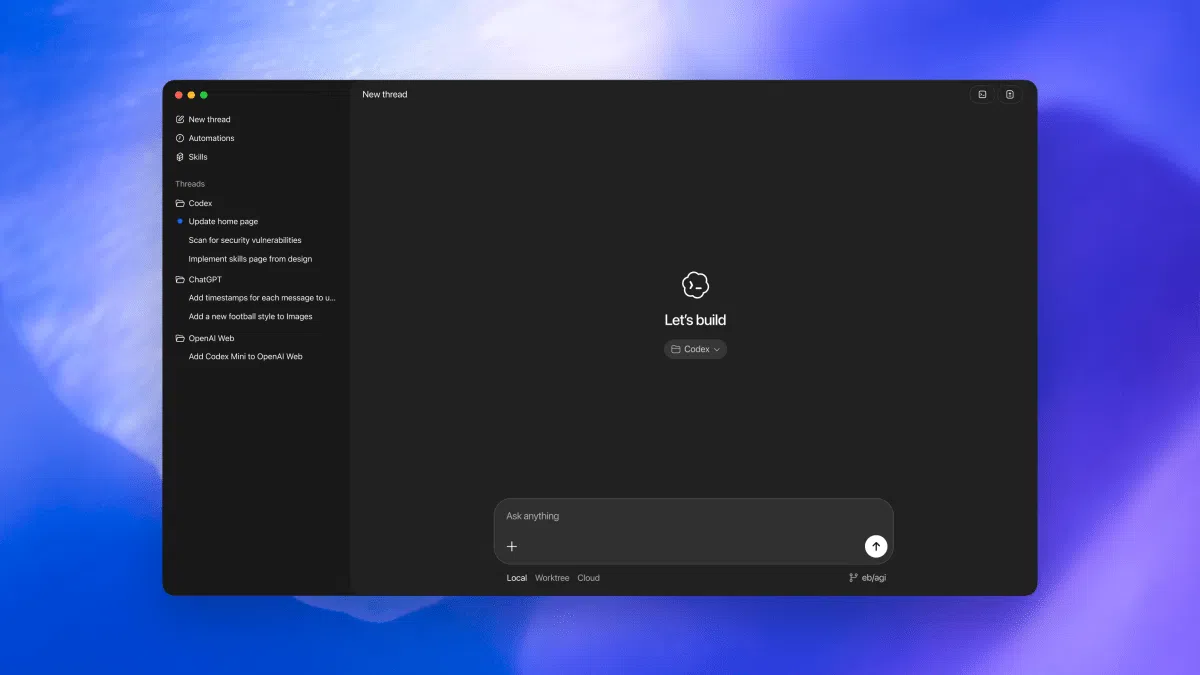

OpenAI于本周一正式发布了面向macOS的Codex桌面应用,这是继去年命令行工具和网页版后,OpenAI在代码生成生态的第三次重要迭代。该应用主打“代理式编程”,支持多个AI代理并行处理任务,并内置最新的GPT‑5.2‑Codex模型。发布会现场,CEO Sam Altman 表示,模型的算力已达到行业最高水平,但使用门槛仍偏高,新的本地客户端旨在通过更友好的交互界面让更多开发者受益。

关键功能

- 多代理并行:用户可同时启动多个编程代理,每个代理专注于不同子任务(如代码补全、单元测试、文档生成),结果统一汇总至任务队列。

- 可配置人格:提供“务实”“同理心”等人格预设,影响代理的代码风格与注释倾向,满足不同团队的代码规范。

- 后台自动化:支持设定定时任务,自动拉取代码库并执行重构或安全审计,完成后将报告推送至用户的通知中心。

- 本地化运行:应用基于Apple Silicon优化的GPU加速库,在本地完成模型推理,降低对云服务的依赖,提升隐私安全。

- 与IDE深度集成:内置VS Code插件,可在编辑器中直接调用Codex代理,实现“一键生成‑调试‑提交”。

与竞争对手对比

| 项目 | OpenAI Codex macOS | Claude Code | Gemini 3 |

|---|---|---|---|

| 模型基座 | GPT‑5.2‑Codex | Claude Opus | Gemini 3‑Pro |

| 并行代理 | 支持多达8个 | 单代理 | 支持4个 |

| 本地运行 | ✅(Apple Silicon) | ❌(仅云端) | ✅(部分) |

| 人格定制 | 多人格预设 | 单一风格 | 可调参数 |

从基准测试来看,GPT‑5.2‑Codex在TerminalBench上保持领先,但在SWE‑bench等真实错误修复任务上,与Claude Opus和Gemini 3的差距已在误差范围内。OpenAI的优势在于本地化部署和高度可配置的工作流,而竞争对手则侧重于云端协同和更轻量的模型体积。

市场影响与前景

Codex macOS应用的推出标志着生成式AI从云端服务向本地生产工具的转型。对企业而言,能够在内部网络中完成代码自动化,有助于降低数据泄露风险;对个人开发者,则意味着无需频繁切换浏览器,即可在本地完成从原型到可部署代码的全链路。

Analyst 预测,2026年下半年,基于本地大模型的开发工具市场规模将突破30亿美元,OpenAI凭借生态优势和强大的模型算力有望占据超过25%的市场份额。与此同时,随着Claude Code和Gemini系列持续迭代,代理式编程的竞争格局仍将保持高度动态,产品的可扩展性和跨平台兼容性将成为下一轮竞争焦点。

“我们希望把最强的模型能力包装进一个易用的本地客户端,让开发者的创造力不受网络和算力的限制。”——Sam Altman, OpenAI CEO

总体来看,OpenAI的Codex macOS应用不仅为现有开发者提供了更高效的AI助理,也为生成式AI在软件工程领域的深度落地奠定了重要基础。