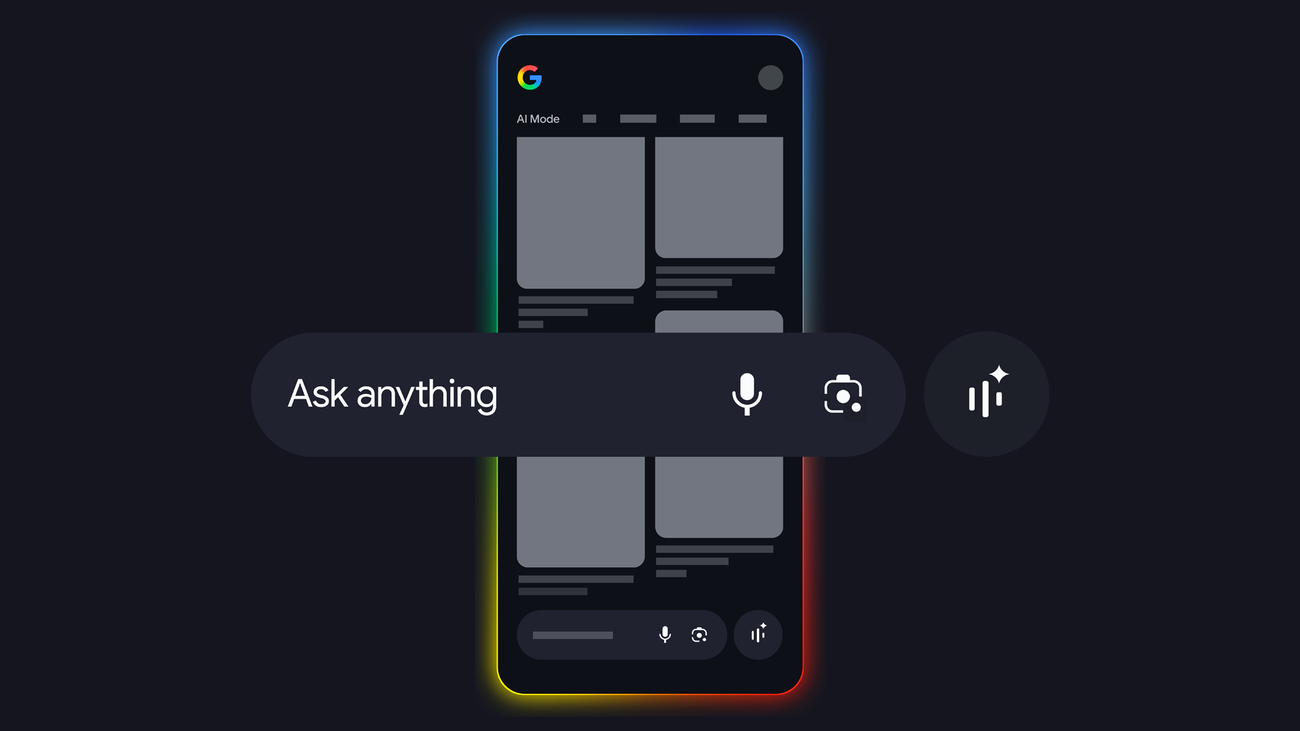

Google AI模式让视觉搜索一次识别多对象,开启多搜索并行新体验

•2 阅读•3分钟•应用

GoogleGemini视觉搜索Google Lens

•2 阅读•3分钟•应用

背景与需求

随着智能手机和社交媒体的普及,用户经常会在图片中寻找灵感——无论是整套服装、家居摆设还是艺术作品。传统的视觉搜索只能一次识别单一对象,用户需要多次手动点击才能获取完整信息,效率低下。Google 为此推出了 AI Mode,旨在让搜索能够“一图多查”,一次性返回完整场景的答案。

技术原理:Fan‑out 多搜索

- 多对象分解:AI Mode 首先使用 Gemini 模型对上传的图片进行分割和标签化,识别出图片中的每个独立实体(如帽子、鞋子、桌子等)。

- Fan‑out 技术:识别后,系统会并行触发多条搜索请求,每条请求对应一个对象的查询。

- 结果聚合:搜索后端返回的结果被快速读取、筛选,并在后台合成一段结构化的答复,呈现在同一页面上。

“AI 模型充当‘大脑’,视觉搜索后端相当于‘图书馆’,两者协同完成多对象推理与信息检索。”——Google Search 高级工程总监 Dounia Berrada

Gemini 模型的多模态能力

- 图文协同:Gemini 同时处理图像像素和自然语言提示,能够理解用户的上下文意图(例如“这套装扮适合春季吗?”)。

- 工具调用:模型会判断何时调用 Lens、何时调用普通网页搜索或特定数据库,实现工具的动态选择。

- 规模与效率:得益于最新的 Transformer 架构和大规模预训练,Gemini 能在毫秒级完成图像解析并生成查询列表。

场景与影响

- 电商购物:用户拍摄整套服装或家居陈设,AI Mode 即可返回每件商品的购买链接、价格与相似推荐,极大提升转化率。

- 生活指南:上传花园照片,系统会一次性提供每种植物的养护要点、适宜气候以及购买渠道。

- 文化教育:在博物馆拍摄展厅,AI Mode 能一次性解释每幅画作的作者、年代与艺术背景,帮助游客深度学习。

展望

AI Mode 的多搜索并行技术为视觉搜索设立了新标杆,未来可能进一步融合实时 AR、语音交互以及更细粒度的对象关系推理。随着 Gemini 系列模型的迭代,搜索体验将从“看到即搜索”向“看到即理解”迈进,助力用户在海量信息中快速获取全景答案。

本文基于 Google 官方发布的技术访谈与产品说明撰写,旨在为业界提供客观的技术解读。

本文是对第三方新闻源的主观解读。消息可能出现过时、不准确、歧义或错误的地方,仅供参考使用。点击此处查看消息源。