Satya Nadella阐述微软AI核心竞争力与平台新方向

在近期的Stratechery访谈中,微软CEO Satya Nadella 深入剖析了公司在生成式AI时代的定位、与OpenAI的合作、内部MAI模型布局以及Project Solara等新平台的战略意义,展望了算力、软件与Agent业务的协同路径。

在近期的Stratechery访谈中,微软CEO Satya Nadella 深入剖析了公司在生成式AI时代的定位、与OpenAI的合作、内部MAI模型布局以及Project Solara等新平台的战略意义,展望了算力、软件与Agent业务的协同路径。

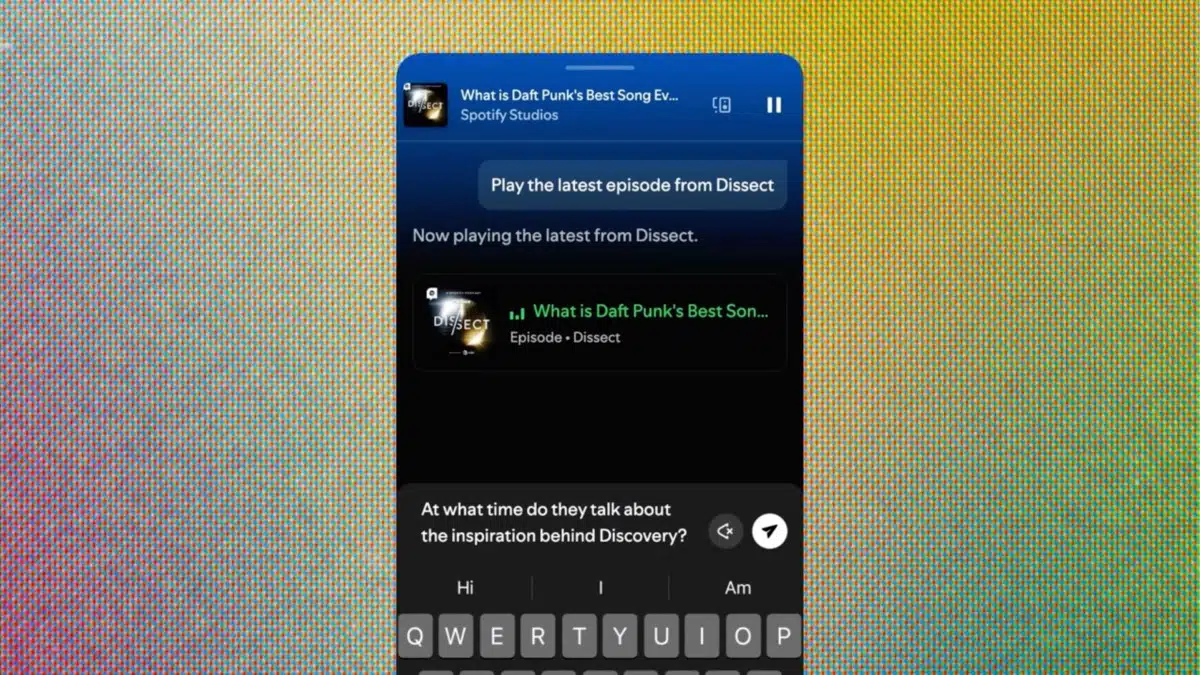

在本月的Computex大会上,Nvidia公布了全新RTX Spark PC芯片,并与Microsoft共同推出首批搭载该芯片的Windows电脑;同场Microsoft在Build大会上展示了“Project Solara”,一个基于Android的AI代理设备平台,并同步发布了自研的MAI模型系列。业界普遍关注这两大布局对AI算力与终端形态的深远影响。

Alphabet宣布通过股权融资募集80亿美元,其中10亿美元由伯克希尔哈撒韦认购。此举旨在为公司的AI算力扩张提供资金,标志着资本成为AI竞争的关键资源。

ZeroEntropy 今日开源 4 B 参数的 Qwen3‑基跨编码器 Zerank-2,提供从查询‑文档配对打分到两阶段检索‑重排的完整方案。该模型在金融、法律、代码等多领域实验中显著提升 NDCG@10,成为 RAG 系统的高精度增益层。

OmniVoice Studio是一款完全本地运行的开源桌面应用,提供语音克隆、视频配音、实时转写和说话人分离等功能,支持 646 种语言的文本转语音,无需 API 密钥、云账号或订阅费用,为用户提供高隐私的全链路离线生成方案。

MarkTechPost 今日发布了一套基于 TuringEnterprises/Open-MM-RL 数据集的完整多模态强化学习工作流。文章从数据结构、图像分布到答案类型进行全方位统计,并构建可验证的奖励函数、视觉语言模型提示模板,最终导出 GRPO‑style 数据,为后续大模型强化学习提供可靠基准。

NVIDIA FLARE团队发布了完整的联邦学习实验教程,演示如何在非IID CIFAR-10数据上对比FedAvg和FedProx两大算法。文章提供完整代码、参数配置及可视化结果,为企业落地联邦学习提供可复制的实践方案。

随着Model Context Protocol(MCP)下载量突破9700万/月,AI代理在企业应用中的渗透率预计2026年底将达到40%。在此背景下,身份认证成为关键瓶颈。本文梳理了WorkOS、Stytch、Auth0、Composio、Nango、Arcade、TrueFoundry 与 Cloudflare Workers八大平台的合规性、功能深度与落地适配,帮助企业快速选型。

WorkOS今日发布auth.md协议,提供基于OAuth的标准化注册文件,帮助AI代理在无需人工填写表单的情况下完成身份验证、凭证获取与撤销,显著提升企业AI集成的安全性与自动化水平。

腾讯近日在MIT许可证下开源TencentDB Agent Memory,提供符号化短期记忆与四层长周期记忆金字塔的本地化解决方案。该系统基于SQLite+sqlite-vec,融合BM25与向量检索,在OpenClaw和Hermes中实现,官方基准显示令牌使用下降61%,任务成功率提升逾50%。

本教程展示如何在Anthropic的Claude模型之上,借助开源SuperClaude框架构建包含指令、代理、模式和会话记忆的多步骤工作流,实现从需求构思到代码实现的全链路AI辅助开发。本文还提供完整代码示例和实战案例,帮助开发者快速上手并提升Prompt的一致性与角色感知。

Garry Tan 领衔开源项目 GBrain v0.38.2.0 今日正式发布,提供基于 markdown 与本地 PGLite 的自连线记忆层。该层通过正则推理自动构建类型化知识图谱,零 LLM 调用即可实现结构化检索,为 AI 代理提供持久且可编辑的上下文记忆。

OpenMythos 在 GitHub 开源的循环深度 Transformer 实现,本文通过 Google Colab 教程构建 MLA 与 GQA 两种注意力变体,比较参数规模与循环注入矩阵的谱半径,并在合成求和任务上验证循环次数对推理深度的提升,展示了在固定参数下通过增加循环实现更强推理能力的可行路径。